I costi nascosti dell’AI

Non si tratta solo di abbonarsi ad uno strumento di GenAI.

Nei giorni scorsi hanno fatto molto rumore le dichiarazioni di Jason Calacanis, investitore tecnologico tra i più noti della Silicon Valley. La notizia è stata ripresa sia sui social, ovviamente, sia su diversi quotidiani e siti di news. In un podcast, il manager racconta che, presso una delle sue organizzazioni, il costo degli agenti AI basati sull’API di Claude è salito rapidamente a 300 dollari al giorno, per agenti che, ammette lui stesso, rimpiazzavano solo una frazione del lavoro di un dipendente. I costi raggiungono valori dell’ordine dei 100.000 dollari all’anno per un singolo agente.

La vicenda rimanda all’annosa discussione sul ruolo dell’AI nello sviluppo e nella gestione del software: l’idea che “fare AI” significhi sottoscrivere un abbonamento, aprire un’interfaccia e cominciare a usare Claude, ChatGPT o Gemini, che il costo sia la sottoscrizione mensile e che tutto il resto venga da sé.

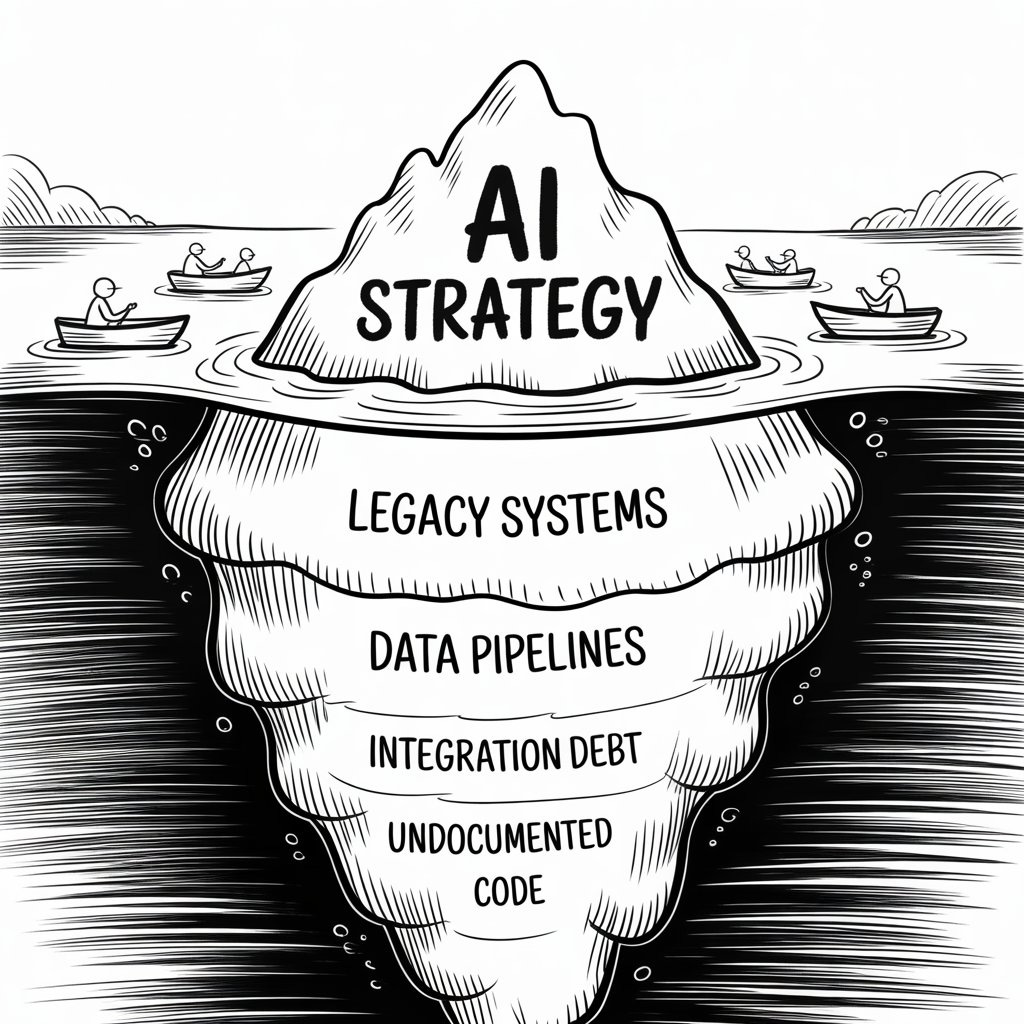

In realtà, quello che si vede è solo la punta dell’iceberg.

Il vero volume è sotto il livello dell’acqua.

Ne avevo già parlato in precedenza, discutendo del rapporto tra il coding e il resto del processo di ingegneria del software. Ma ci sono diversi aspetti che meritano un approfondimento ulteriore.

Il prezzo che non vedi in fattura

Partiamo da un dato tratto da una recente ricerca pubblicata su MIT Sloan Management Review (Walsh, “5 Heavy Lifts of Deploying AI Agents”, MIT Sloan, 2025). I ricercatori hanno analizzato il deployment di un sistema ad agenti AI per rilevare eventi avversi nei pazienti oncologici a partire dalle note cliniche: un caso reale in un contesto particolarmente critico. Il risultato è che meno del 20% dello sforzo complessivo è stato dedicato al prompt engineering e allo sviluppo del modello. Oltre l’80% è stato consumato da ciò che i ricercatori chiamano “lavoro sociotecnico” — integrazione dei dati, allineamento con gli stakeholder, governance, integrazione nei flussi di lavoro esistenti. Si tratta di un contesto clinico ad alta complessità — dati sensibili, sistemi legacy, requisiti normativi — ma la proporzione è rivelatrice di una distorsione sistematica: anche nei deployment meno critici, il lavoro sommerso è quasi sempre molto più del previsto. Quattro a uno. Questo è il rapporto reale tra ciò che si vede — il modello, l’interfaccia, la demo — e ciò che definisce il vero costo.

Non è un dato isolato. PwC, nel suo AI Predictions 2026, arriva alla stessa proporzione da un'angolazione completamente diversa — non lo sforzo, ma il valore. Il 20% del risultato di un'iniziativa AI proviene dalla tecnologia, l'80% dalla riprogettazione del lavoro. I numeri coincidono.

Lo stesso Jack Gallifant, autore principale della ricerca, è esplicito: “Per essere pronti a un deployment di un agente, bisogna avere pipeline di dati consistenti e infrastrutture di serving già operative. Tutto questo non è banale, richiede molto più sforzo di quanto la maggior parte delle persone si aspetti ed è probabilmente la parte più sottovalutata dell’intera storia.”

Non basta un prompt

C’è una frase di Asia Solnyshkina, fondatrice e CEO di ProSense.Digital, citata da CIO Magazine che vale la pena tenere a mente quando si parla di AI nello sviluppo software (Gross, “AI Is Altering the Economics of Software Development”, CIO Magazine, 2025):

“I nostri clienti non pagano per il codice grezzo. Pagano per il giudizio, l’architettura, le integrazioni complesse, la responsabilità. Non puoi risolvere tutto questo con un prompt.”

È una frase che suona ovvia, ma che molte organizzazioni ignorano sistematicamente. Si guarda alla produttività immediata — “questo strumento mi aiuta a scrivere il codice più velocemente” — senza calcolare i costi indiretti: la qualità del codice prodotto, il tempo di revisione umana che resta necessario, il redesign dei processi che l’adozione dello strumento richiede.

In un articolo del 6 aprile (e aggiornato proprio oggi), il New York Times ha evidenziato il cuore del problema. Gli agenti AI — Claude Code, Codex — generano codice così rapidamente che le aziende non riescono a trovare a sufficienza ingegneri per revisionarlo. Secondo Joe Sullivan, advisor di Costanoa Ventures, “Non esistono abbastanza application security engineer sul pianeta per soddisfare ciò di cui le sole aziende americane hanno bisogno”. È un costo nascosto che non appare in nessuna subscription, ma che si paga — in vulnerabilità, in crash, in ritardi, in rischio reputazionale (Griffith, "The Big Bang: A.I. Has Created a Code Overload", NYT, 2026).

La proliferazione silenziosa

Ma il problema non si limita alla qualità del codice. Il caso di Calacanis non è solo un problema di costi delle API non monitorati. È il sintomo di qualcosa di più profondo: la velocità con cui gli agenti proliferano all'interno delle organizzazioni, spesso senza che nessuno ne abbia una visibilità d'insieme.

Qualcuno nel team attiva un agente per un compito, funziona, lo racconta ai colleghi e, all'improvviso, ti ritrovi con quindici agenti in esecuzione, senza visibilità su cosa stanno facendo.

(Bertha, “Without Controls, an AI Agent Can Cost More Than an Employee”, CIO Magazine, 2025).

Questa frase descrive una dinamica che ricorda molto il fenomeno dello shadow IT — ma con differenze importanti. Lo shadow IT produce sistemi isolati, difficili da scalare. Gli agenti AI producono costi variabili, dinamici, correlati alla complessità dei task e possono crescere in modo non lineare.

CSO Online, in un articolo dedicato specificamente al fenomeno, lo chiama “shadow AI”: l’uso non autorizzato di strumenti AI da parte dei dipendenti, spesso al di fuori di qualsiasi processo di approvazione aziendale (Ghoshal, “The CISO’s Guide to Responding to Shadow AI”, CSO Online, 2025). Andrew Walls, vicepresidente analista di Gartner, è netto: “Every CISO I talk to has discovered some form of shadow AI.”

La shadow AI si sviluppa in molteplici modalità. I dipendenti usano strumenti AI non approvati — talvolta esplicitamente banditi — perché ritengono che possano renderli più produttivi, e nessuno ha ancora definito alternative ufficiali. I vendor, nel frattempo, attivano funzionalità AI nei loro prodotti: a volte, l’AI entra nell’organizzazione senza che nessuno l’abbia deliberatamente scelta. Il risultato è un perimetro di governance che si espande ogni giorno, invisibilmente, senza che i costi — di sicurezza, di compliance, di esposizione dei dati — siano mai stati messi a budget.

La governance è il cuore del problema

Nella ricerca del MIT citata in precedenza, i ricercatori identificano cinque “heavy lifts” — i carichi pesanti — del deployment di agenti AI: integrazione dei dati, validazione dei modelli, governance, valore economico, continuous monitoring. Per ciascuno di questi, il costo non è determinato dal modello. È il lavoro umano, organizzativo, procedurale che ci vuole intorno.

La governance, in particolare, viene descritta come il punto in cui molte organizzazioni si perdono: “Chi è responsabile se qualcosa va storto? Ogni passaggio del sistema è legalmente e proceduralmente sicuro? Quali decisioni chiave sta prendendo il modello e chi deve essere informato?” Queste non sono domande tecniche. Sono domande organizzative. E nelle organizzazioni che le ignorano, il costo del fallimento è reale — di reputazione, legale, operativo.

Beth Stackpole, scrivendo sempre su MIT Sloan Management Review, è diretta: “Senza metriche condivise e robuste, è difficile dimostrare il valore — o anche solo sapere se questi sistemi stanno davvero raggiungendo i risultati desiderati, anziché introdurre silenziosamente nuovi rischi.” (Stackpole, “Agentic AI, Explained”, MIT Sloan, 2025).

Sia chiaro, non voglio dire che l’AI non valga l’investimento. Sto dicendo che l’investimento va davvero calcolato, non immaginato. I costi nascosti — dati, integrazione, governance, change management, lock-in, qualità — devono essere messi sul tavolo prima di ogni progetto, non scoperti a posteriori.

“Fare qualcosa con Claude” è facile. E per molti compiti individuali — scrivere, sintetizzare, ragionare su un documento — il valore è reale e immediato, senza bisogno di grandi infrastrutture. Il problema nasce quando si scala, quando si portano gli agenti AI all’interno di un’organizzazione, si integrano con sistemi esistenti e si pretende che producano valore misurabile e ripetibile. Farlo in modo che produca valore misurabile, sostenibile, sicuro — quello è un altro mestiere.

Disclaimer: questo post è stato realizzato con il supporto di Claude.

© 2026 Alfonso Fuggetta & Sonia Montegiove. Salvo diversa indicazione, tutti i contenuti di questa pubblicazione sono protetti da copyright e rilasciati con licenza CC BY-NC-ND 4.0: https://creativecommons.org/licenses/by-nc-nd/4.0/deed.it

I costi nascosti sono sempre quelli organizzativi, non tecnologici. Integrare l’AI in un’azienda significa cambiare processi, formare persone, ridisegnare responsabilita’. La tecnologia e’ la parte facile.